Der Tod des Augenzeugen

Es gab eine Zeit, da war ein Foto ein Versprechen. Es war das, was Roland Barthes in “die Helle Kammer” als das „Ça-a-été“ bezeichnete. (1)

Das „Es-ist-gewesen“.

Wenn wir ein Bild sahen, wussten wir instinktiv: Das Licht, das von einem Objekt reflektiert wurde, hat physisch einen Film oder einen Sensor berührt. Das Foto war eine Lichtspur, ein Beweis, ein Augenzeuge.

Dieses ontologische Versprechen ist gebrochen. Das ontologische Versprechen ist schlicht und einfach, dass das Fotografierte auch tatsächlich existiert hat.

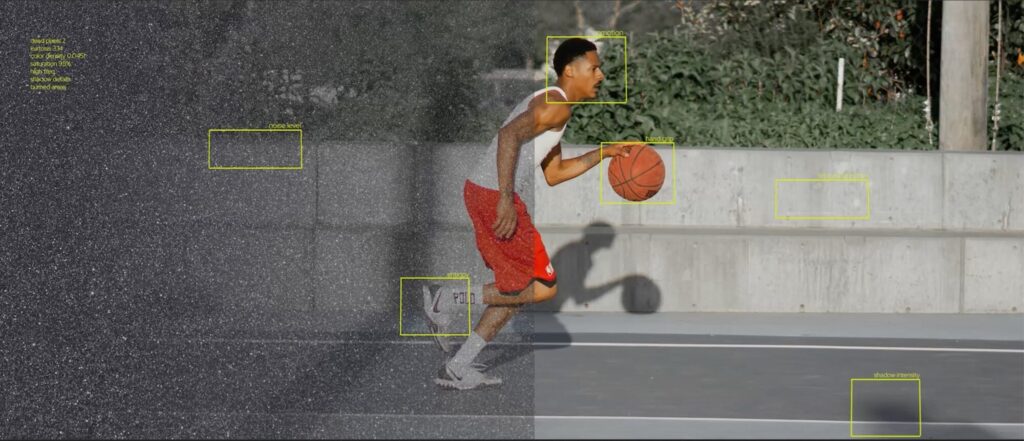

Bild oben: Kanada 2025 – keine KI

Wir sind an einem Punkt angekommen, an dem der Satz „Ich glaube nur, was ich sehe“ nicht nur naiv, sondern gefährlich geworden ist.

Wir erleben einen fundamentalen Paradigmenwechsel: Wir bewegen uns weg von der Authentizität, einem gefühlten Wahrheitsgehalt, der dem Bild innewohnt – hin zur Authentifizierung – einem technischen Beweis, der von außen hinzugefügt werden muss.

Ich erinnere mich noch sehr gut an meine ersten Erfahrungen in MidJourney und den frühen Versionen von DALL-E. Spielerisch und so offensichtlich Fake, dass es sich anfühlte wie Flipper spielen. Die Faszination, Bilder nur aus der Fantasie zu erzeugen, war großartig. Doch spätestens, als das Papst-Bild (der Papst in silberner Daunenjacke) auftauchte, empfand ich zum erste Mal ein Gefühl von Unsicherheit. Ist da echt? Kann das sein?

In einer Welt, in der generative KI fotorealistische Perfektion erreicht hat, reicht die bloße optische Prüfung nicht mehr aus. Wir müssen umlernen. Wir müssen lernen, nicht mehr dem Bild selbst zu trauen, sondern seiner Herkunftskette.

Die ontologische Krise: Wenn Bilder keine Spuren mehr sind

Um zu verstehen, was gerade passiert, müssen wir unterscheiden zwischen Detektion und Depiktion.

Die traditionelle Fotografie basierte auf Detektion: Ein physikalischer Vorgang, bei dem Photonen auf Materie treffen. Es ist ein ursächlicher Zusammenhang.

Ein KI-Bild hingegen basiert auf Depiktion: Es ist die Darstellung einer Idee ohne physischen Inhalt in der realen Welt.

Ein KI-generiertes Bild ist keine Aufnahme eines Moments, sondern eine statistische Wahrscheinlichkeit aus einem riesigen Datensatz (erfahre hier mehr über die Funktionsweise von Bildgeneratoren).

Es berechnet, wie ein Bild aussehen müsste, nicht wie es war.

Der Fall von Boris Eldagsen hat dies eindrucksvoll illustriert. Als er mit seinem KI-Bild „The Electrician“ den Sony World Photography Award gewann und den Preis anschließend ablehnte, tat er der Fotografie-Szene einen großen Dienst. Er zwang uns zur Diskussion.

Bild oben: (c) Boris Eldagsen, The Electrician (2022)

Sein Argument: KI-Bilder sind keine Fotografie. Sie sind eine eigene Entität, für die er den Begriff „Promptographie“ prägte.

Wir befinden uns in der Phase der „Post-Fotografie“. Bilder werden zu flüchtigen Datenströmen. Sie verlieren ihre angestammte Funktion als „Speicher der Erinnerung“ und werden zu „Optionen der Realität“.

Für mich als Fotograf fühlt sich das im ersten Moment wie Diebstahl an, als ob das Bild an Seele und Bedeutung verliert. Doch der eigentliche Trugschluss ist zu glauben, die Fotografie selbst sei bedroht. Fotografie als Detektion, das Sammeln von Licht, ob auf Korn oder Pixel, bleibt immer echt und einzigartig.

Die wahre Herausforderung liegt nicht in der Existenz der Promptographie als neues Genre, ähnlich wie einst die Fotografie ihren Platz neben der Malerei finden musste. Das Problem ist die rasende Geschwindigkeit, mit der diese neuen Bilder unseren Alltag fluten. Wir haben schlichtweg keine Zeit und keine gelernten Mittel, um im Sekundenbruchteil zu überprüfen: Ist das Realität oder Berechnung? Und genau diese Überforderung öffnet die Tür für eine noch viel tiefgreifendere Gefahr.

Die Psychologie des Zweifels: Der „Liar’s Dividend“

Die vielleicht größte soziologische Gefahr liegt jedoch nicht darin, dass wir auf einen Deepfake des Papstes in Daunenjacke hereinfallen. Das Risiko ist subtiler und perfider. Experten nennen es den „Liar’s Dividend“ (die Dividende des Lügners) (2).

Wenn alles gefälscht sein kann, sinkt die Beweiskraft von allem, was echt ist.

Täter, Politiker oder Unternehmen können heute behaupten, belastende Videos oder Fotos seien KI-generiert, selbst wenn sie absolut authentisch sind. Die bloße Existenz der KI-Technologie liefert die perfekte Ausrede, um sich der Verantwortung zu entziehen. Das führt dazu, dass wir resignieren, weil wir uns der Situation machtlos ausgeliefert fühlen. Wir geben auf, zwischen Wahrheit und Lüge unterscheiden zu wollen, und ziehen uns in den Zynismus zurück: „Man kann ja eh nichts mehr glauben.“

Beispiele wie der gefälschte Pentagon-Anschlag (3), der kurzzeitig die Börsenkurse bewegte, zeigen, dass diese Desinformation längst monetarisiert und als Waffe eingesetzt wird.

Jüngste Vorfälle, wie durch die durch Grok generierten, sexualisierte Bilder, die mit einfachen Prompts und von jedem erstellt werden können, zeigen das Ausmaß (4). Es handelt sich dabei nicht nur um eine Diffamierung vereinzelter, sondern kann jeder Frau, oder jedem Mann treffen.

Eine Utopie, wie ich mir sie nicht vorstellen kann und eine Lösung fehlt mir auch. Ich sehe die große Gefahr, dass praktisch jeder mit einem digitalen Leben, geklont werden könnte. Persönliche Daten können missbraucht werden für alltägliche Geschäfte, oder sensible private Aspekte (Gesundheit).

Wir müssen also mehr denn je, jeglichen Inhalt Misstrauen, zweifeln und uns schützen.

So gut es eben geht.

Technik als neuer Anker: Von der Optik zur Mathematik

Wie reagieren wir darauf? Die Industrie versucht, das Problem technisch zu lösen. Wenn wir unseren Augen nicht mehr trauen können, müssen wir der Mathematik trauen.

Das Stichwort lautet Content Credentials (C2PA) oder Wasserzeichen (Google SynthID).

Man kann sich das vorstellen wie eine digitale Nährwerttabelle für Bilder. Der offene C2PA Standard zeigt nicht zwingend an, ob ein Bild „wahr“ ist, sondern lediglich woher es kommt und wie es bearbeitet wurde.

Kamerahersteller wie Leica (mit der M11-P), Sony und Nikon haben begonnen, kryptografische Signaturen direkt in die Hardware zu integrieren. Das Bild wird im Moment der Entstehung, noch auf dem Sensor, digital signiert. Das Ziel ist eine lückenlose Beweiskette vom Auslöser bis zum Bildschirm des Betrachters.

Auch Gemälde und Analoge Bilder wurden gefälscht, Wasserzeichen sind nichts neues. Problematisch finde ich, das jedes Bild unter “ Gneralverdacht” steht und der Urheber beweisen muss, wo es her kommt. Der User muss also sein opt-in geben. Fotografie bleibt zwar echt, es muss jedoch immer bewiesen werden können.

Gut also, dass Kamerahersteller das erkannt haben. Ich würde vorallem jeden professionell Arbeitenden Fotografen empfehlen, auf derartige interne Signierungen Wert zu legen. Vielleicht ist es im Moment noch nicht immer relevant, KI verändert unsere digitale Welt allerdings mit Sprint-Tempo. Außerdem sollte das zum eigenen Qualitätsanspruch gehören.

Wasserzeichen sind aber nur ein Teil, wie Bilder und Videos als KI gekennzeichnet bzw. erkannt werden können.

In einem jüngst veröffentlichten Artikel seitens der ARD (5), beschreibt Christoph Behl von itsreal.media einen kürzlich entwickelten Ansatz, Deepfake und KI-Bilder zu erkennen. Im Grunde geht es hier um drei Kernaspekte, welche untersucht werden:

- Metadaten und Wasserzeichen-Analyse

- TechnischeAnalyse und Vision AI

- Semantischeund kontextabhängige Analyse

Bild oben: illustration – ai detection – itsrealmedia

Spannend sind hier auch die Details, die manche Bilder entlarven. Die Quintessenz des Beitrages ist aber das, was ich ebenso als wichtiger denn je erachte: „Stattdessen rückt mehr die Frage nach der Authentizität und Plausibilität in den Vordergrund“. Es obligt als an jedem von uns, kritisches Denken zu fördern.

Die Rückkehr des Menschlichen: Perfektion ist verdächtig

Es gibt jedoch eine faszinierende Gegenbewegung. In einer Flut von perfekter, rauschfreier, ideal ausgeleuchteter KI-Ästhetik gewinnen technische Unvollkommenheiten plötzlich an Wert.

Rauschen. Bewegungsunschärfe. Eine leicht falsche Fokussierung. Komplexes, chaotisches Licht. Diese „Fehler“ werden zu Zertifikaten menschlicher Anwesenheit. Sie signalisieren: Hier war ein Mensch, hier war ein physischer Apparat, hier war Chaos.

Ein erfrischendes Beispiel ist Miles Astray. Als Gegenstück zu Eldagsen reichte er ein echtes Foto eines Flamingos in einen KI-Kunstwettbewerb ein – und gewann (und wurde disqualifiziert). (6)

Bild oben: (c) Miles Astray – FLAMINGONE (2024)

Seine Botschaft war kraftvoll: Die Natur und der menschliche Blick können immer noch surrealer und fantastischer sein als jeder Algorithmus.

Wir erleben eine Renaissance des Analogen, nicht nur aus Nostalgie, sondern als Schutzmechanismus. Der physische Film, das Negativ, wird zum ultimativen Beweis des „Dagewesenseins“. Ein Negativstreifen ist ungleich schwerer zu hacken als ein Datensatz.

Aber auch in der digitalen Fotografie ist der Trend zu erkennen. Ich Analysiere jedes Jahr den Kameramarkt und in den letzten 3-4 Jahren geht es gezielt in eine Richtung. Kleine, unperfekte Kameras mit einer Ästhetik. Kameras aus den früheren 2000er Jahren sind heiß begehrt. Kompakte Kameras im Retro Look, Kameras welche echt sind, gern aus hochwertigen metallischen Materialien. Alles was schreit: ich bin echt und meine Bilder haben nicht den Anspruch, perfekt zu sein.

Fazit & Ausblick: Eine neue Medienkompetenz

Was bedeutet das für uns – Fotografen, Bildredakteure, Konsumenten?

Wir müssen unsere Medienkompetenz radikal aktualisieren. Das intuitive Bauchgefühl („Es sieht echt aus“) muss durch einen analytischen Prozess ersetzt werden: „Wo sind die Metadaten? Wer ist der Absender? Gibt es eine Signatur?“

Institutionen wie World Press Photo haben bereits reagiert und ziehen klare Grenzen: Keine generative KI in dokumentarischen Kategorien. Das Foto muss ein „Lichtabdruck“ bleiben.

Vielleicht und das ist eine gewagte Hoffnung: Rettet die KI am Ende die authentische Fotografie.

Indem sie die Bilderflut mit synthetischem Material sättigt, zwingt sie uns dazu, den dokumentarischen Wert echter Fotografie nicht mehr als selbstverständlich hinzunehmen, sondern ihn aktiv zu schätzen, zu schützen und zu verifizieren.

Wir müssen lernen, dem Bild wieder zu misstrauen, um die Wahrheit darin zu retten.

Ich wünsche dir möglichst viele echte Momente.

Quellen:

1:

Die helle Kammer: Bemerkungen zur Photographie (suhrkamp taschenbuch) / S.87

2:

Deep Fakes: A Looming Challenge for Privacy, Democracy, and National Security“ (2018/2019)

5:

6:

https://news.artnet.com/art-world/miles-astray-non-ai-photo-wins-ai-competition-2500809